Bạn đã bao giờ tự hỏi liệu những con người trong hình ảnh hoặc video bạn thấy trên mạng xã hội có thực sự là thật hay không? Trong thời đại công nghệ số, việc phân biệt thật – giả ngày càng trở nên khó khăn hơn với sự xuất hiện của Deepfake. Vậy cụ thể Deepfake là gì? Cách hoạt động như thế nào? Chúng ta cần làm gì để bảo vệ bản thân khỏi nguy cơ bị lừa đảo bởi Deepfake?”

Deepfake là gì?

Định nghĩa Deepfake

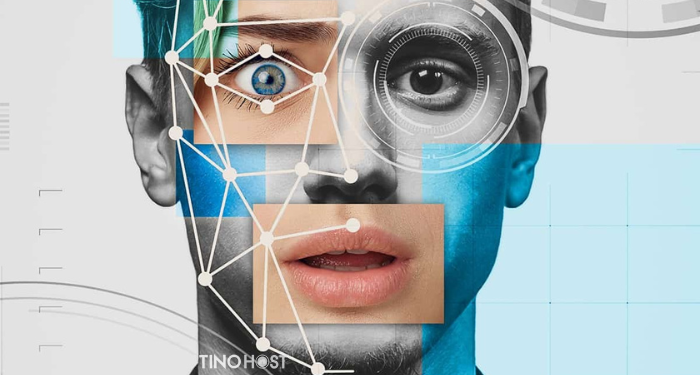

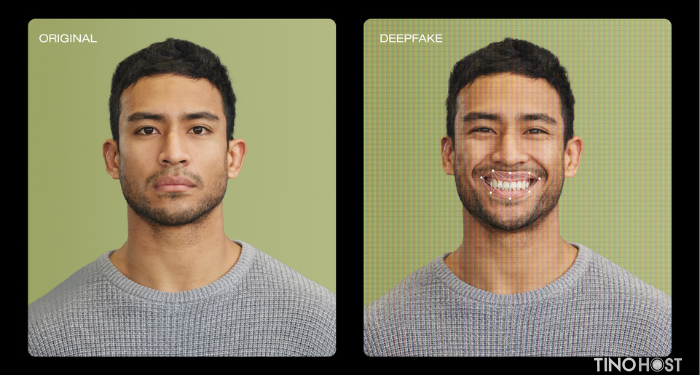

Deepfake là thuật ngữ được ghép từ “deep learning” (học sâu) và “fake” (giả mạo). Đây là một kỹ thuật sử dụng trí tuệ nhân tạo (AI) để tạo ra hình ảnh, âm thanh và video giả mạo một cách tinh vi. Công nghệ này có thể được sử dụng để thay thế khuôn mặt của một người trong video bằng khuôn mặt của người khác, hoặc để tạo ra hoàn toàn một video giả mạo, khiến người xem khó có thể phân biệt được với thực tế.

Tuy nhiên, Deepfake cũng có thể được sử dụng để tạo ra các video hài hước hoặc các hiệu ứng hình ảnh ấn tượng. Do đó, việc sử dụng Deepfake cần được cân nhắc kỹ lưỡng và có trách nhiệm.

Lịch sử phát triển của Deepfake

Khởi đầu (2014-2017)

- 2014: Ian Goodfellow, Yoshua Bengio và Aaron Courville giới thiệu Generative Adversarial Networks (GANs) – nền tảng cốt lõi cho Deepfake.

- 2017: Deepfake subreddit được tạo ra, nơi người dùng chia sẻ các video Deepfake đầu tiên.

Phát triển (2017-2020)

- 2017: Video Deepfake đầu tiên của Tom Cruise lan truyền trên mạng, thu hút sự chú ý của công chúng. Ban đầu, công nghệ này chủ yếu được sử dụng để tạo ra nội dung khiêu dâm giả mạo về những người nổi tiếng.

- 2018: FaceApp, một ứng dụng di động sử dụng Deepfake để thay đổi khuôn mặt, trở nên phổ biến.

- 2019: Deepfake lần đầu được sử dụng trong các chiến dịch truyền thông chính trị, gây lo ngại về việc thao túng dư luận.

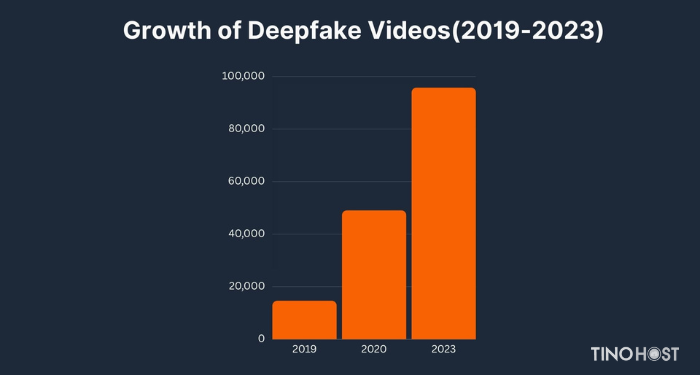

- Trong báo cáo “The State of Deepfakes: An Overview” được Deeptrace, một công ty chuyên nghiên cứu về Deepfake, xuất bản vào tháng 9 năm 2019, có tới 14.678 video Deepfake trực tuyến, đánh dấu mức tăng gần 100% so với con số 7.964 trước đó vào tháng 12 năm 2018.

- Ngoài ra, 96% trong số tất cả các video Deepfake được đăng công khai đều có nội dung khiêu dâm, chủ yếu nhắm mục tiêu đến các cá nhân trong ngành giải trí.

Nâng cao (2020-nay)

- 2020: Deepfake trở nên tinh vi hơn, khó phân biệt với thực tế hơn. các nhà nghiên cứu đã tìm thấy hơn 85.000 video giả mạo và con số này tiếp tục tăng lên sau mỗi 6 tháng.

- 2021: Deepfake được sử dụng trong các bộ phim và chương trình truyền hình, như “The Mandalorian”.

- 2022: Các công nghệ phát hiện Deepfake được phát triển, nhưng vẫn chưa hoàn thiện.

- 2023: Theo báo cáo State of Deepfakes của Homesecurityheroes, một nền tảng cung cấp phân tích toàn diện về hiện trạng công nghệ Deepfake cho biết, số lượng video Deepfake trực tuyến là 95.820 đánh dấu mức tăng 550% so với năm 2019.

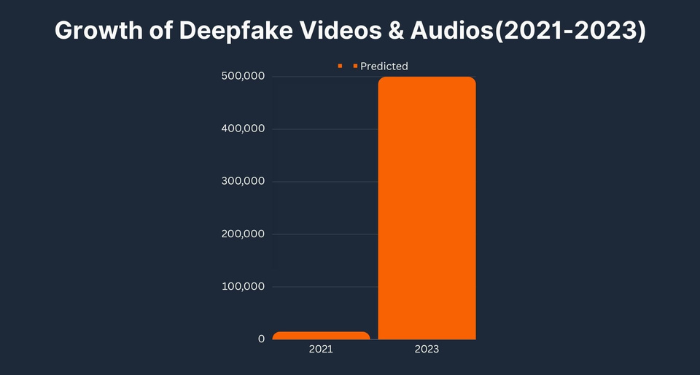

Theo DeepMedia, một công ty chuyên phát hiện Deepfake, có khoảng 500.000 video và giọng nói Deepfake được chia sẻ toàn cầu trên mạng xã hội vào năm 2023.

Cũng theo Homesecurityheroes, nội dung khiêu dâm Deepfake chiếm 98% tổng số video deepfake trực tuyến 2023. Trong số này, 99% nhắm đến phụ nữ, trong đó, ca sĩ và diễn viên Hàn Quốc là nhóm được nhắm tới nhiều nhất (53%). Ngoài ra, 94% những người xuất hiện trong nội dung khiêu dâm Deepfake làm việc trong ngành giải trí.

Cách thức hoạt động của Deepfake

Deepfake hoạt động dựa trên ba bước chính:

Bước 1: Thu thập dữ liệu

Thu thập một lượng lớn dữ liệu hình ảnh hoặc video của người thật. Dữ liệu này có thể bao gồm ảnh chân dung, video tự quay, video phỏng vấn,…

Chất lượng và độ đa dạng của dữ liệu sẽ ảnh hưởng trực tiếp đến chất lượng của Deepfake.

Bước 2: Huấn luyện mô hình AI

Sử dụng thuật toán học sâu để huấn luyện một mô hình AI dựa trên dữ liệu thu thập được. Mô hình AI này sẽ học cách phân biệt các đặc điểm khuôn mặt, cử chỉ và biểu cảm của người thật và tự tạo ra các hình ảnh và video mới dựa trên các đặc điểm này.

Bước 3: Tạo Deepfake

Sử dụng mô hình AI đã được huấn luyện để tạo ra các hình ảnh, video hoặc âm thanh giả mạo. Mô hình AI sẽ áp dụng các đặc điểm khuôn mặt, cử chỉ và biểu cảm của người thật vào một khuôn mặt hoặc cơ thể khác.

Sau đó, ta sẽ nhận được kết quả là một video trông giống như người thật đang nói hoặc làm điều gì đó mà họ chưa từng làm.

Có hai phương pháp chính để tạo Deepfake:

- Face swapping: Thay thế khuôn mặt của người trong video bằng khuôn mặt của người khác.

- Morphing: Biến đổi khuôn mặt của người trong video để họ trông giống như người khác.

Deepfake ngày càng trở nên tinh vi và khó phát hiện hơn. Một số kỹ thuật tiên tiến được sử dụng trong Deepfake bao gồm:

- Generative Adversarial Networks (GANs): Sử dụng hai mạng nơ-ron đối nghịch để tạo ra hình ảnh và video giả mạo ngày càng giống thật.

- 3D face reconstruction: Tạo ra mô hình 3D của khuôn mặt người thật để áp dụng vào khuôn mặt hoặc cơ thể khác.

- Voice cloning: Tạo ra giọng nói giả mạo của người thật để áp dụng vào video Deepfake.

Thật giả lẫn lộn với công nghệ Deepfake – Một số ví dụ điển hình

Công nghệ Deepfake đang ngày càng phát triển mạnh mẽ, cho phép tạo ra những video và âm thanh giả mạo vô cùng tinh vi. Điều này đã dẫn đến sự gia tăng các vụ lừa đảo gây ra nhiều hậu quả nghiêm trọng.

Theo thống kê từ Businesswire, lừa đảo deepfake đang gia tăng ở Bắc Mỹ. Tại Mỹ, các trường hợp Deepfake được sử dụng để lừa đảo đã tăng từ 0,2% lên 2,6% từ năm 2022 đến quý 1 năm 2023. Tại Canada, tỷ lệ này đã tăng từ 0,1% lên 4,6% .

Bài báo Onfido đưa tin số vụ lừa đảo Deepfake tăng đáng kể gấp 31 lần từ năm 2022 đến năm 2023.

Dưới đây là một số vụ lừa đảo nổi tiếng trên thế giới bằng công nghệ Deepfake và giả giọng bằng AI:

Vụ lừa đảo giả mạo người thân yêu cầu chuyển tiền

Năm 2023, báo Quân Đội Nhân Dân có đưa tin trường hợp chị V.T.M (26 tuổi ở Long Biên, TP Hà Nội) nhận được tin nhắn mượn tiền từ tài khoản Facebook của một người thân bên nước ngoài với nội dung nhờ chuyển tiền vào một số tài khoản 75 triệu đồng. Lúc này, chị V.T.M đã cẩn thận gọi video lại để kiểm tra thì thấy hình ảnh đúng là người quen của mình nên đã tin tưởng chuyển khoản luôn.

Tuy nhiên, một thời gian sau, chị V.T.M thấy trên trang cá nhân của người thân đó đăng bài thông báo việc bị kẻ gian hack tài khoản Facebook để hỏi vay tiền một số bạn bè và người thân. Sau khi gọi điện lại để xác nhận lần nữa, chị V.T.M mới biết mình bị lừa.

Vụ lừa đảo CEO

Năm 2019, một CEO của một công ty năng lượng ở Anh đã bị lừa đảo chuyển khoản 243.000 USD sau khi nhận được một cuộc gọi điện thoại Deepfake. Giọng nói của người gọi được giả mạo thành giọng nói của CEO tập đoàn mẹ ở Đức, yêu cầu chuyển khoản tiền khẩn cấp.

Vụ lừa đảo tình cảm

Năm 2020, một phụ nữ ở Singapore đã bị lừa đảo hơn 20.000 USD sau khi yêu một người đàn ông trên mạng xã hội. Người đàn ông này đã sử dụng Deepfake để tạo ra các video giả mạo, khiến người phụ nữ tin rằng anh ta là một doanh nhân thành đạt.

Vụ lừa đảo tin tức

Năm 2021 khi xung đột giữa Nga và Ukraine leo thang, một video Deepfake được lan truyền trên mạng xã hội, trong đó Tổng thống Ukraine Volodymyr Zelenskyy kêu gọi quân đội đầu hàng Nga. Video này được tạo ra bởi các hacker Nga nhằm mục đích gây hoang mang và chia rẽ người dân Ukraine.

Vụ lừa đảo tiền điện tử

Năm 2022, một nhóm tội phạm đã sử dụng Deepfake để tạo ra video giả mạo Elon Musk, CEO của Tesla, quảng bá cho một dự án sàn giao dịch tiền điện tử có tên BitVex. Với hứa hẹn cho phép người dùng gửi tiền và thu về 30% lợi nhuận mỗi ngày, nhóm này đã thu hút được hơn 2 triệu USD từ các nhà đầu tư tin tưởng.

Dấu hiệu nhận biết và cách phòng tránh lừa đảo bằng Deepfake

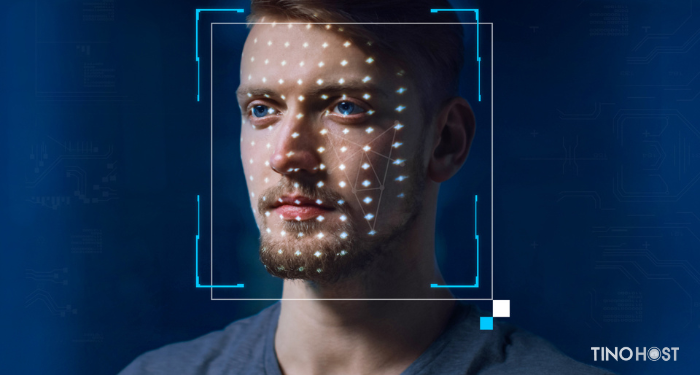

Dấu hiệu nhận biết video Deepfake

Khuôn mặt

- Chuyển động không tự nhiên: Công nghệ Deepfake thường gặp khó khăn trong việc mô phỏng các chuyển động tinh tế của khuôn mặt, chẳng hạn như chuyển động của mắt, mí mắt và môi.

- Da và tóc không hoàn hảo: Da trong video Deepfake có thể trông mịn màng một cách bất thường hoặc có hiện tượng “bóng ma” xung quanh tóc.

- Bất thường về ánh sáng và bóng đổ: Ánh sáng và bóng đổ trong video Deepfake có thể không nhất quán hoặc không khớp với môi trường xung quanh.

Âm thanh

- Âm thanh không khớp với hình ảnh: Âm thanh trong video Deepfake có thể bị méo hoặc không khớp với cử động miệng của người nói.

- Giọng nói: Giọng nói trong video Deepfake có thể nghe giống như robot hoặc thiếu cảm xúc.

Cử chỉ và hành động

- Cử chỉ không tự nhiên: Cử chỉ của người trong video Deepfake có thể trông gượng gạo hoặc không khớp với lời nói của họ.

- Hành động không logic: Hành động của người trong video Deepfake có thể không logic hoặc không phù hợp với tình huống.

Nguồn gốc video

- Nguồn gốc không rõ ràng: Nếu bạn không thể xác định nguồn gốc của video, hoặc video được đăng tải trên một trang web hoặc kênh YouTube ít người biết đến, thì đây có thể là dấu hiệu của Deepfake.

- Bình luận bất thường: Hãy đọc các bình luận dưới video để xem liệu có ai khác nghi ngờ video là Deepfake hay không.

Biện pháp phòng tránh lừa đảo bằng Deepface

- Cảnh giác với những video hoặc hình ảnh có nội dung bất ngờ, khó tin, hoặc quá hoàn hảo. Ví dụ như video một người nổi tiếng đang nói hoặc làm điều gì đó trái với hình ảnh thường thấy của họ.

- Chú ý đến các chi tiết nhỏ trong video hoặc hình ảnh, như cử chỉ, giọng nói, ánh sáng, và độ phân giải. Deepfake có thể tạo ra hình ảnh và video rất giống thật, nhưng vẫn có thể có những chi tiết nhỏ bị sai sót.

- Sử dụng các công cụ hỗ trợ để phát hiện Deepfake. Có một số công cụ miễn phí có thể giúp bạn phát hiện Deepfake, như Deepfake Detection Challenge (DFDC) và FakeCatcher.

- Kiểm tra kỹ nguồn gốc của video hoặc hình ảnh trước khi chia sẻ. Không chia sẻ những nội dung từ các nguồn không uy tín hoặc không rõ ràng.

- Nâng cao nhận thức bằng cách tìm hiểu về Deepfake và cách thức hoạt động của công nghệ này. Việc hiểu rõ về Deepfake sẽ giúp bạn cảnh giác hơn trước những nội dung giả mạo. Đồng thời, hãy chia sẻ thông tin về Deepfake với người thân và bạn bè.

Theo hướng dẫn từ Báo Chính Phủ, nếu nhận được một cuộc gọi yêu cầu chuyển tiền gấp, trước tiên, bạn hãy bình tĩnh và xác minh thông tin bằng cách:

- Liên lạc trực tiếp với người thân, bạn bè thông qua một kênh khác xem họ có thật sự cần tiền không.

- Kiểm tra kỹ thông tin số tài khoản được yêu cầu chuyển tiền vào. Nếu là tài khoản lạ, bạn cần cảnh giác và không nên tiến hành giao dịch.

- Nếu cuộc gọi từ người tự xưng là đại diện cho ngân hàng, hãy gác máy ngay lập tức và gọi trực tiếp đến hotline chính xác của ngân hàng để xác nhận cuộc gọi.

- Các cuộc gọi thoại hay video có chất lượng kém, chập chờn cũng là một yếu tố để bạn nghi ngờ tính xác thực của cuộc gọi.

Một số khía cạnh tích cực của Deepfake

Mặc dù Deepfake thường được gắn liền với những nguy cơ lừa đảo nhưng công nghệ này cũng mang lại một số mặt tích cực trong nhiều lĩnh vực khác nhau.

Giải trí và sáng tạo

- Deepfake có thể được sử dụng để tạo ra các video hài hước, các hiệu ứng hình ảnh ấn tượng, hoặc các bộ phim giả tưởng với kỹ xảo cao. Ví dụ: Deepfake có thể được sử dụng để thay đổi khuôn mặt của diễn viên trong phim, tạo ra các nhân vật ảo hoặc biến đổi môi trường trong phim.

- Deepfake cũng có thể được sử dụng để tạo ra các trải nghiệm VR/AR sống động và chân thực hơn.

Nghệ thuật

Deepfake có thể được sử dụng để tạo ra các tác phẩm nghệ thuật độc đáo và sáng tạo. Ví dụ: Deepfake có thể được sử dụng để tạo ra các bức tranh chân dung di chuyển, các tác phẩm điêu khắc 3D có thể thay đổi biểu cảm hoặc các video nghệ thuật với hiệu ứng đặc biệt.

Giáo dục

- Deepfake có thể được sử dụng để tạo ra các tài liệu giáo dục sinh động và hấp dẫn. Ví dụ: có thể sử dụng Deepfake để tạo ra các mô phỏng lịch sử, các bài giảng tương tác hoặc các video giáo dục với các nhân vật ảo.

- Deepfake cũng có thể được ứng dụng để giúp học sinh rèn luyện các kỹ năng như thuyết trình, giao tiếp và giải quyết vấn đề.

Y tế

- Deepfake có thể được sử dụng để tạo ra các mô phỏng phẫu thuật, giúp bác sĩ chuẩn bị cho các ca phẫu thuật phức tạp.

- Deepfake cũng có thể được sử dụng để tạo ra các video hướng dẫn cho bệnh nhân về cách sử dụng thuốc hoặc thực hiện các bài tập vật lý trị liệu.

Kinh doanh

Deepfake có thể được sử dụng để tạo ra các video quảng cáo và tiếp thị hấp dẫn và thu hút sự chú ý của khách hàng. Ngoài ra, công nghệ này cũng có thể được sử dụng để tạo ra các video đào tạo cho nhân viên hoặc các video giới thiệu sản phẩm.

Kết luận

Deepfake là một công nghệ đang phát triển nhanh chóng, vì vậy, các phương pháp lừa đảo sử dụng Deepfake cũng sẽ ngày càng tinh vi. Do đó, bạn cần luôn cảnh giác khi tiếp xúc với các video hoặc hình ảnh trực tuyến. Việc sử dụng deepfake một cách có trách nhiệm, tuân thủ pháp luật và đạo đức là điều cần thiết để đảm bảo rằng công nghệ này được sử dụng cho mục đích tốt đẹp.

TÀI LIỆU THAM KHẢO

- Báo Chính Phủ. (2023, July 11). Cảnh giác trước cuộc gọi lừa đảo “Deepfake”. baochinhphu.vn. https://baochinhphu.vn/canh-giac-truoc-cuoc-goi-lua-dao-deepfake-102230711152931189.htm

- Genk. (2023). Làm thế nào để tránh bẫy lừa đảo bằng Deepfake?. genk.vn. https://genk.vn/lam-the-nao-de-tranh-bay-lua-dao-bang-deepfake-20230330141909702.chn

- Sumsub. (2023, November 28). Sumsub Research: Global Deepfake Incidents Surge Tenfold from 2022 to 2023. sumsub.com. https://sumsub.com/newsroom/sumsub-research-global-deepfake-incidents-surge-tenfold-from-2022-to-2023/

- Roop Reddy. (2023, December 13). 24 Deepfake Statistics – Current Trends, Growth, and Popularity (December 2023). contentdetector.ai. https://contentdetector.ai/articles/deepfake-statistics

- Homesecurityheroes. (2023). 2023 state of deepfakes: realities, threats, and impact. homesecurityheroes.com. https://www.homesecurityheroes.com/state-of-deepfakes/

Những câu hỏi thường gặp

Ai là những người chịu ảnh hưởng nhiều nhất bởi sự phát triển của Deepfake?

Những người chịu ảnh hưởng nhiều nhất bởi sự phát triển của Deepfake có thể bao gồm:

- Chính trị gia và nhân vật nổi tiếng

- Giới nghệ sĩ và giải trí

- Cơ quan chính phủ và tổ chức phi lợi nhuận

- Những người không am hiểu về công nghệ

Deepfake được sử dụng nhiều nhất để làm gì?

Theo thống kê từ nhiều trang uy tín như Homesecurityheroes, Onfido, Contentdetector,… Deepfake được sử dụng nhiều nhất để ghép mặt người nổi tiếng vào các video khiêu dâm.

Pháp luật làm thế nào để đối phó với vấn đề Deepfake?

Các quy định về quyền riêng tư và danh dự đang được áp dụng để bảo vệ cá nhân khỏi việc sử dụng hình ảnh hoặc video Deepfake một cách không đúng đắn hoặc xâm phạm quyền riêng tư của họ.

Deepfake được xem như một hành vi lừa đảo nếu nó được sử dụng để tạo ra thông tin giả mạo để đánh lừa người khác. Các quy định về lừa đảo và gian lận sẽ được áp dụng để trừng phạt những hành vi này.

Có phải chỉ những người công nghệ cao mới có thể tạo ra Deepfake?

Thực tế, các công cụ và phần mềm tạo Deepfake đã trở nên phổ biến và dễ sử dụng. Điều này có nghĩa là bất kỳ ai cũng có thể tạo ra Deepfake mà không cần kỹ năng kỹ thuật cao.

Một số ứng dụng, công cụ trực tuyến tạo Deepfake gồm: Reface, Avatarify, MyHeritage, Jiggy, Morphin, DeepFaceLab, Faceswap.dev,…

Lưu ý: Việc sử dụng Deepfake cần được cân nhắc kỹ lưỡng và có trách nhiệm để tránh những nguy cơ tiềm ẩn.